就在今天凌晨一点一年一度的Google I/O大会在Google总部举行。在CEO劈柴叔Sundar Pichai的带领下,对Google过去一年所做出的成就进行了介绍与发布。以下便是此次大会的精彩看点。

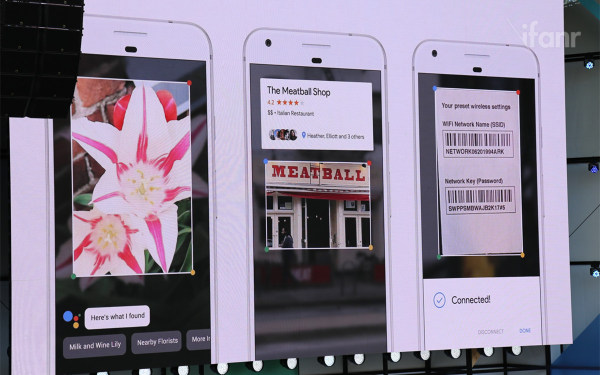

Google Lens:

此次大会的主角依然是Google Assitant,劈柴叔在简短的介绍了去年一年的成就之后,便直接推出了一款基于人工智能的产品:Google Lens。Google Lens具有很多炫酷的功能,比如:当你看到一朵花很漂亮的花,却不知道它的品种时,只需打开Google Lens,通过摄像头对其取景,便会得到与它有关的各种信息,还有当你走在大街上犹豫去哪个餐厅就餐时,只要将摄像头对准餐厅的门派,便能得到该餐厅的各种信息。但最令我感到酷炫的功能是,连接WIFI时,再也不用一个一个字母的输入密码,只要将摄像头对这带有账号密码的WiFi图取景时,便会自动连接。

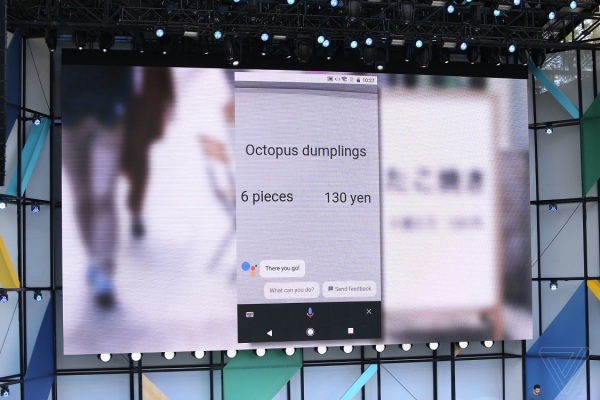

Google Assistant:

在去年使用Google Assistant的时候只能语音输入,但是大多情况下人们使用频繁最多的输入方式还是文字输入。因此,在今年Google在Google Assistant中加入了文字输入功能。

此外,Google Assistant除了添加了文字输入功能之外,还集成了Google Lens添加了直接翻译功能,当你看不懂某些词或句的时候,只需使用摄像头取景,Google Assistant便会对其进行直接翻译。

在过去的一年中,Google不遗余力的对Google Assistant进行推广,其不仅在Android平台上占据人工智能助手的主角地位,也将入驻iPhone,到时候Google Assistant和Siri的相处可是一个问题。另外,Google还致力于将Google Assistant添加到各种日常生活用品中,只有你想不到,没有Google做不到。

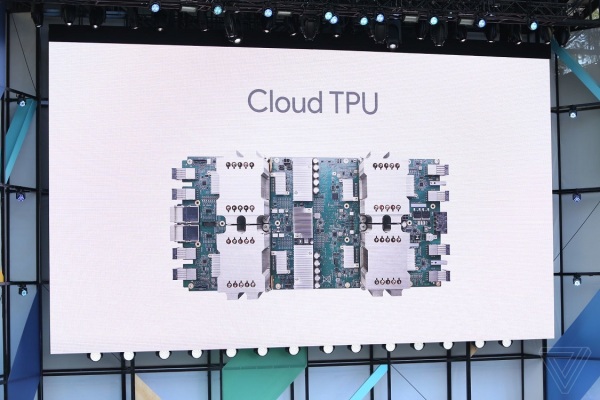

Cloud TPU:

在过去几年,Google 在机器学习方面取得了不少的进步。这些成果大大提高了 Google 翻译的质量,也在 Google 搜索结果中发挥了关键作用,与此同时使用 Google Photos 查找您想要的照片将更为方便。强大的学习功能也为 AlphaGo 人工智能系统提供了预测和作决策的基础功能,这使得 DeepMind 的 AlphaGo 能够打败世界顶级棋手之一李世石。不过,Google 第一代的 TPU 在针对不同用途时,仍然需要分开单独培训,这样的培训需要花费很多的时间成本。于是,Google 设计了一个全新的机器学习系统,以消除瓶颈并最大限度地提高整体性能。这个系统的核心就是 Google 今天推出的第二代 Tensor 处理单元(TPU),它可以训练和运行机器学习模型,Google 将其称之为 Cloud TPU。现在,Google 表示,Cloud TPU 已经全面投入使用,并且正部署在 Google Compute Engine 这个平台上,它将 64 个 Cloud TPU 组合成 TPU Pods,有效地将 Google 服务器变为具有 11.5 petaflops 计算能力的超级计算机,每个 Cloud TPU 可提供高达 180 teraflops 的浮点性能来培训和运行机器学习模型。使用这些 TPU Pods,可以有效的减少机器学的培训时间,以往一个大型的翻译模组,需要花费 32 个最好的商用 GPU 用上一整天的时间完成,但现在,只需要八分之一的 TPU Pod 就能达到同样的效果和精准度。而这对于培训系统更普遍的意义是,通过大量的计算来改进 AI 软件。所以当硬件性能越强大的时候,你得到的结果就越快。这不仅能缩短时间,还能提高每个机器学习者更快速地进行迭代和进行更多实验的能力。为了帮助尽可能多的研究人员,进一步加快开放机器学习研究的步伐,Google 也将通过 TensorFlow 研究云免费为机器学习研究人员提供 1000 个 Cloud TPU 。它成为 Google 在探索 AI 领域拓荒路上强有力的功臣。

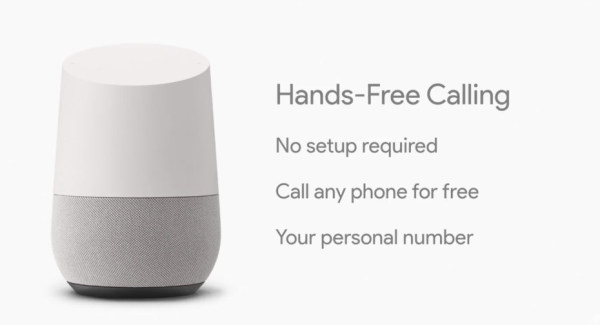

Google Home:

Google Home正如它的宗旨”Hands Free”,致力于解放双手,让你多动嘴,少动手。是又一款基于Google Assistant的产品。但今年Google在硬件方面并没有多大的改变,但却添加了一些更能贯彻其宗旨的功能。1.用户可以直接通过Google Home拨打电话,并且无需设置便是免提模式,用户可以用自己的手机号与Google Home匹配,若全家共用一个Google Home,Google Home可以绑定多个号码,拨号时,会根据拨号人的声音识别号码进行拨号。这项功能完全免费,但目前只能在美国和加拿大使用。2.Google Home支持状态提醒功能,也支持蓝牙连接,可以连接在手机上播放音乐。另外还有几个内容合作方:HBO Now、Spotify免费版和YouTube TV.

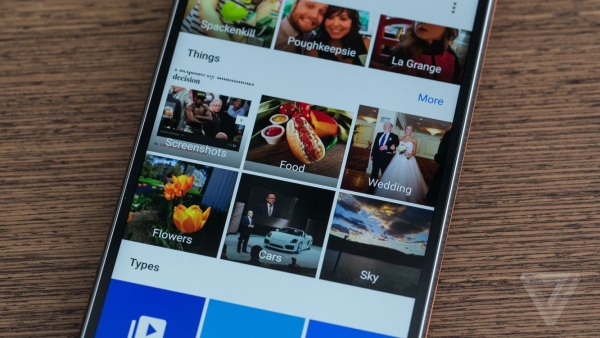

Google Photos:

此次Google Photos退出了许多新功能:1.Suggested Sharing,它能够只能识别中照片中包含的人,一键将照片发送给他,这样以后再也不用怕合影不用自己手机就永远看不到照片的痛苦了。2.Shared Libraries,不同于Suggest Sharing,Shared Libraries是自动将照片分享给你提前设定好的人。3.Google Photos还推出相册集功能,不过得付费。

Android:

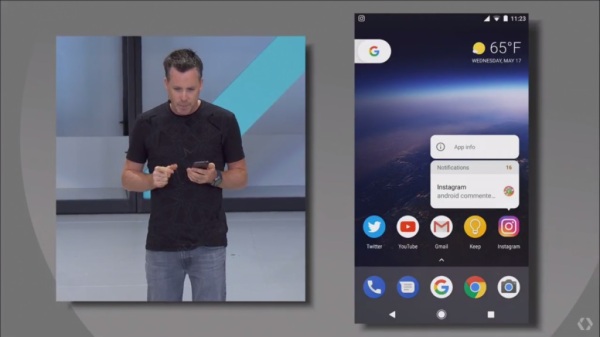

终于到了我最关心的部分了,此次大会基于Android的时间不是很多,可以发现Android曾经I/O大会主角的地位已经易主了。Google在今年3月份放出了Android O系统的首个开发者预览版,不过从Android5.0开始,每一代的Android改变不大,无非就是各种优化。Android 0系统也是,很难说出它与Android N的区别,不过Android O确实做了很多优化。当初Android N便实现了多窗口模式,这个模式将两个同时开启的应用分割成上下两个界面,但用户体验并不是很好,于是在Android 0中做了优化,实行“画中画”模式,比如:当你正在播放YouTube视频时,只需按下Home键,YouTube便会以小窗口的形式悬浮在屏幕上,你可以通过滑东调节它的位置,想关闭直接将它滑出屏幕外即可。另外,Android已经把kotlin设为官方语言,这可以说是很多Android开发者梦寐以求的。

另外,Android O还添加了Notification Dots功能,它类似于IOS的3D Touch。

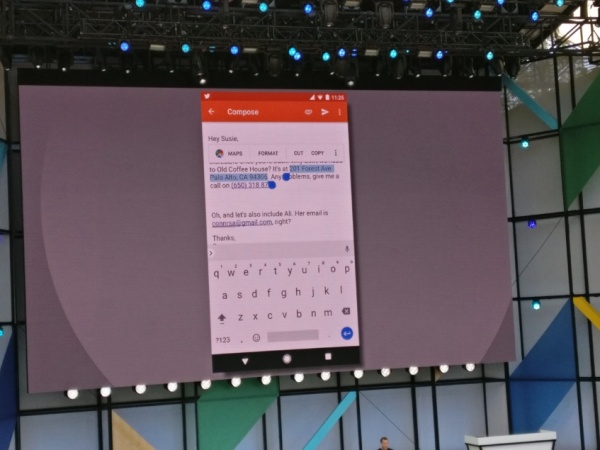

还有两个小功能,一个是自动填表功能,另一个是Smart Text Selection。Smart Text Selection又是基于人工智能的功能。

AI:

在这次的I/O大会中可以看到人工智能无处不在。Google 也宣布,将把 AI 从云端直接植入在设备中,同时也发布了其机器学习框架的移动设备版本:TensorFlow Lite。机器学习应用可以更快的运行,且相较于存在于云端的数据更加的安全,更重要的是,它可以脱离网络离线工作,当前的 AI 都不能脱离网络独立工作。这也将使得用户有更好的使用体验,Google 也可以从中获得更直接的用户使用习惯。 Google 认为,你手中的下一个手机,将会拥有一个住着 AI 的芯片。

VR和AR:

此次I/O大会,VR和AR并没有占据太多的篇幅。Daydream平台迎来了全新的 VR 设备——独立的头戴式设备 Daydream VR一体机 ,Google 将其定位于中端 VR 产品,它既不是入门级的纸盒 + 手机,也不是像 HTC Vive 那种需要高配置电脑需求的旗舰产品。Daydream VR 一体机是 Google 与高通、联想以及 HTC 合作的产品。其拥有独立运行的硬件,不需要连接手机或电脑就可以独立运行,但发布会没有公布这款产品的价格等信息,相信一定不便宜。另外,Google VR 副总裁 Clay Bavor表示,今年 LG G6、以及三星 Galaxy S8 也将支持 Google Daydream 平台,用户通过一个简单的软件更新即可获得支持。

此次I/O大会的所有精彩看点就这么多,看到Google发展的如此迅速,我不仅想起了和Google同样靠搜索引擎起家的某度还在卖外卖,真的是相差甚远,真希望有一天,中国能够出现一个和Google一样能够推进时代发展的科技公司。

PS:本篇博客借鉴于:知乎爱范儿。